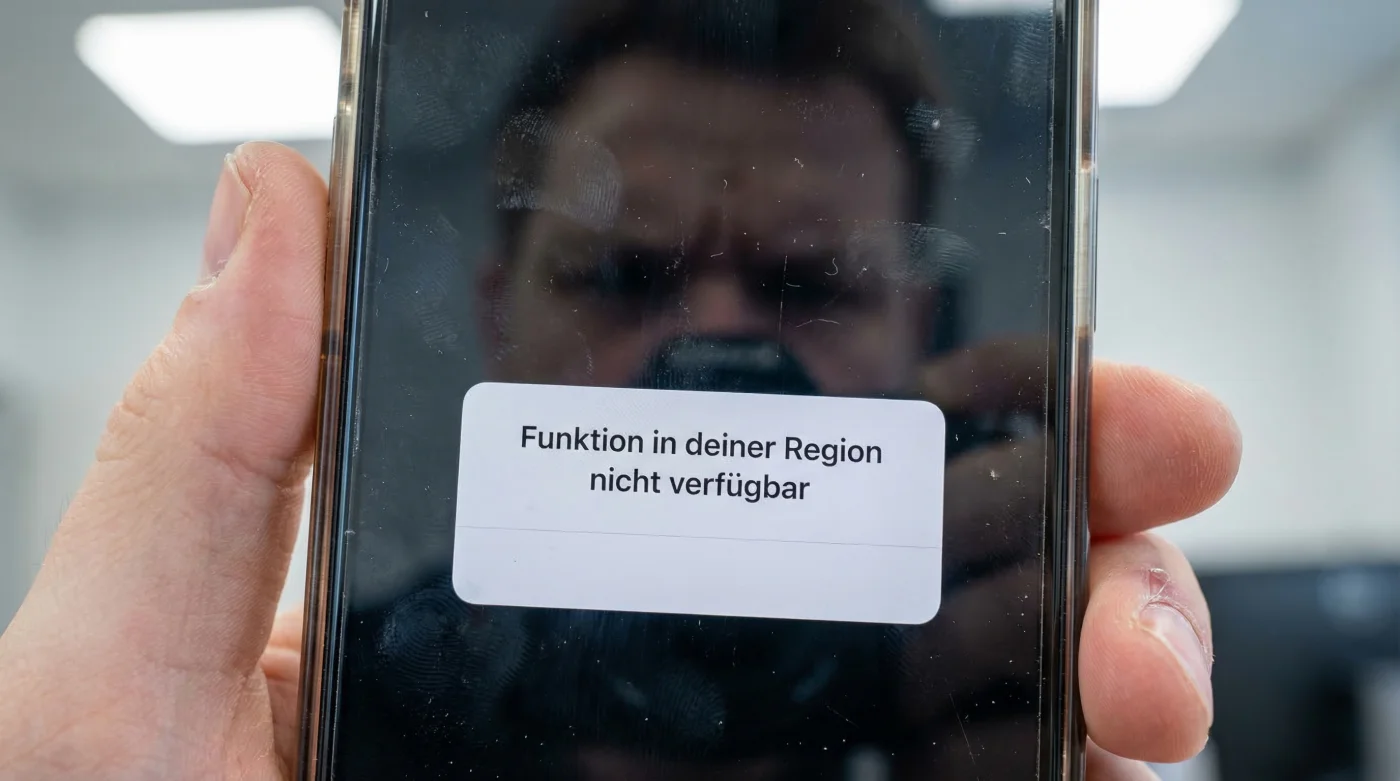

Millionen von Smartphone-Nutzern im DACH-Raum bereiten sich aktuell auf das wohl größte Software-Update des Jahrzehnts vor. Die Erwartungen an Apple Intelligence sind gigantisch, verspricht das System doch eine nie dagewesene Symbiose aus Produktivität und maschinellem Lernen direkt auf dem Gerät. Doch hinter den verschlossenen Türen der Entwicklerzentralen hat sich eine dramatische Wende vollzogen. Eine der am meisten herbeigesehnten Funktionen – die hochkomplexe, automatisierte Analyse von Porträts und Selfies zur Stimmungs- und Gesundheitserkennung – wurde in den europäischen Beta-Versionen still und heimlich aus dem Quellcode entfernt. Ein plötzlicher Schritt, der für deutsche Nutzer einen massiven Funktionsverlust bedeutet.

Dieser drastische Einschnitt geschieht keineswegs aus technischen Gründen, sondern ist das direkte Resultat eines unsichtbaren juristischen Bebens. Während Nutzer in den USA bald in den Genuss kommen, ihre Bildergalerien von einer KI nach emotionalen Nuancen und physischen Parametern sortieren zu lassen, bleibt der europäische Bildschirm in dieser Hinsicht stumm. Der Auslöser ist ein strenges Gesetzespaket aus Brüssel, das den Tech-Giganten in die Knie zwingt und eine radikale Beschneidung der Algorithmen fordert. Um zu begreifen, welche tiefgreifenden Auswirkungen diese Zensur auf unseren digitalen Alltag hat, müssen wir die verborgenen Mechanismen hinter der Kameralinse entschlüsseln.

Der unsichtbare Filter: Warum das iPhone in der EU plötzlich blind wird

Die Entscheidung, die tiefgreifende Bildanalyse zu deaktivieren, fußt primär auf dem neuen Artificial Intelligence Act (AI Act) der Europäischen Union sowie den strengen Vorgaben des Digital Markets Act (DMA). Die europäische Gesetzgebung stuft die automatisierte Auswertung von Gesichtern, die über einfache biometrische Entsperrung wie Face ID hinausgeht, als Hochrisiko-Technologie ein. Apple Intelligence nutzt für die Selfie-Analyse ein Verfahren, das in Fachkreisen als Biometric Categorization bezeichnet wird. Hierbei ermittelt die KI nicht nur die simple Identität, sondern analysiert subtile Mikromimik, Hautveränderungen und emotionale Zustände in Sekundenbruchteilen. Da Apple diese sensiblen Datenmengen systemweit in verschiedene Apps integrieren wollte, kollidierte der revolutionäre Ansatz frontal mit den strengen Datenschutzstandards der EU, die eine explizite, isolierte und jederzeit widerrufbare Zustimmung für jeden einzelnen Datenpunkt fordern.

Experten für Digitalrecht betonen und warnen gleichermaßen, dass die Strafen für Verstöße gegen den AI Act drakonisch ausfallen und bis zu sieben Prozent des weltweiten Jahresumsatzes betragen können. Ein finanzielles und PR-technisches Risiko, das selbst das wertvollste Unternehmen der Welt auf europäischem Boden nicht eingehen möchte. Aus diesem Grund wurde tief im iOS-Code ein striktes Geo-Fencing-Protokoll implementiert, das anhand der Regionaleinstellungen, der GPS-Daten und der aktiven SIM-Karte zweifelsfrei erkennt, ob sich ein Gerät im DACH-Raum befindet, und die entsprechenden Machine Learning-Modelle rigoros blockiert. Doch diese rechtliche Blockade wirft unweigerlich die brisante Frage auf, wer nun eigentlich die Gewinner und wer die Verlierer dieser historischen Entwicklung sind.

Die globale Kluft: Ein Kontinent wird technologisch abgehängt

Die ersatzlose Streichung der Funktion bedeutet im Alltag weitaus mehr, als dass wir auf eine nette technologische Spielerei verzichten müssen. Es geht im Kern um fundamentale Features der intelligenten Fotoverwaltung, der vollautomatisierten Erinnerungserstellung und der fortschrittlichen Barrierefreiheit für sehbehinderte Nutzer. In der Praxis entsteht aktuell ein beispielloses Zwei-Klassen-System der mobilen Technologie, bei dem teure europäische Hardware künstlich softwareseitig gedrosselt wird, obwohl die verbauten Hochleistungsprozessoren exakt die gleiche Rechenleistung von bis zu 35 Billionen Rechenoperationen pro Sekunde erbringen könnten.

| Zielgruppe / Region | Verfügbarkeit der Selfie-KI | Profitierende Funktionen | Verlust / Nachteile für den Nutzer |

|---|---|---|---|

| US-Kunden | Vollständig und systemweit integriert | Smart Mood Sorting, Health Indexing, Advanced Memory Generation | Erhöhtes Risiko für heimliches Profiling und potenzielle Datenschutzverletzungen |

| EU-Nutzer (DACH) | Komplett deaktiviert (Hardware- & Geo-Blocked) | Maximale Privatsphäre, keine biometrische Überwachung im Hintergrund | Massiver Funktionsverlust in der nativen Fotos-App, fehlende Automation im Alltag |

| Professionelle Fotografen | Global abhängig vom physischen Standort | Manuelles Tagging bleibt erhalten, Raw-Daten bleiben völlig unberührt | Wegfall von KI-gestützten Sortieralgorithmen für umfangreiche Porträt-Shootings |

Dieser nüchterne Vergleich verdeutlicht drastisch, dass der kompromisslose Schutz der Privatsphäre in Europa einen extrem hohen Preis in Form von massivem Komfortverlust fordert. Wer die technischen Details dieser gestrichenen Funktionen minuziös analysiert, erkennt erst wirklich, welch gewaltiges Potenzial hier für uns ungenutzt bleibt.

Die Anatomie der Algorithmen: Was die KI im Geheimen wirklich berechnete

- Heidi Klum bestätigt den wahren Grund für den plötzlichen Männer-Vorteil der Jury

- Weder das Muskeltraining noch die Diät konnten den Sturz des Favoriten verhindern

- Ich kaufte gerade Brötchen und plötzlich stand ein ausgewachsener Keiler vor mir

- Der Neue Köpenick-Rekord bricht bereits alle Standards für Berliner Polizeiberichte

- Nach 20 Minuten endet die Jagd durch die Drogerie mit einem Betäubungsschuss

| Wissenschaftlicher Datenpunkt | Technische Metrik / Exakte Dosierung | Prozessierungs-Mechanismus | Konflikt mit geltendem EU-Recht |

|---|---|---|---|

| Emotionale Evaluierung | Auswertung von exakt 52 Gesichtsmuskel-Vektoren | Local On-Device Machine Learning via CoreML | Direktes Verbot der automatisierten Emotionserkennung (Art. 5 AI Act) |

| Hautton- & Texturanalyse | 3D-Tiefen-Mapping via Infrarot (ca. 30.000 Messpunkte) | Computer Vision Framework Apple Internal | Graubereich zur medizinischen Diagnostik ohne erforderliche CE-Zertifizierung |

| Aufmerksamkeits-Tracking | Echtzeit-Blickwinkelmessung mit 0,5 Grad Toleranz | Gaze Estimation Models der Frontkamera | Unzulässiges und ungefragtes Profiling von Nutzerverhalten in Echtzeit |

Diese enorm detaillierte und pfeilschnelle Datenerfassung ermöglichte es der KI bisher, Bilder nicht nur stumpf nach dem Ort oder der Uhrzeit zu sortieren, sondern geradezu menschlich nach der Stimmung eines Urlaubs oder der physischen Vitalität einer Person zu filtern. Wenn diese hochkomplexen, über Jahre trainierten Algorithmen nun für uns brachliegen, stellt sich unweigerlich die praktische Frage, wie sich dieser Verlust im täglichen Umgang mit dem Smartphone äußert und welche Fehlerquellen für den ahnungslosen Nutzer entstehen.

Diagnostik-Leitfaden: Wenn das iPhone scheinbar streikt

Viele deutsche Nutzer, die bereits ungeduldig Entwickler-Betas installieren oder technikaffine Berichte aus den USA verfolgen, wundern sich in Foren über unerwartetes Verhalten ihrer Geräte. Oftmals wird fälschlicherweise ein gravierender Hardware-Defekt oder ein schlampiger Software-Bug vermutet, wenn bestimmte beworbene KI-Funktionen von Apple Intelligence schlichtweg nicht funktionieren. Die folgende Diagnostik-Liste hilft Ihnen, die Symptome richtig und wissenschaftlich fundiert zuzuordnen:

- Symptom: KI-gestützte Emotionen-Filter (wie Glückliche Momente oder Nachdenklich) in der Suchfunktion der Fotos-App fehlen komplett oder liefern null Ergebnisse. = Ursache: Strenges gesetzliches Verbot der biometrischen Kategorisierung nach Emotionen laut der neuen EU-Verordnung.

- Symptom: Automatische Gesundheits-Tags oder unaufgeforderte Hinweise auf übermäßige Müdigkeit durch kontinuierliche Hautton-Analyse sind dauerhaft deaktiviert. = Ursache: Medizinische Diagnostik-Einstufung erfordert zwingend eine offizielle CE-Zertifizierung für Medizinprodukte, deren extrem langwierigen Prozess der Hersteller für eine einfache Foto-App gezielt umgeht.

- Symptom: Generative Bild-Funktionen für Porträts (bekannt als Image Playground) weigern sich strikt, echte Gesichter von gespeicherten Kontakten zu stilisieren oder in Avatare zu verwandeln. = Ursache: Der AI Act fordert absolute juristische Transparenz bei sogenannten Deepfakes; Apple blockiert die KI-Modifikation realer Gesichter innerhalb Europas aus reinen Haftungsgründen.

Wer sein teures Gerät trotz dieser massiven staatlichen Einschränkungen dennoch optimal auf die kommenden großen Updates vorbereiten möchte, muss nun äußerst strategisch und proaktiv vorgehen.

Der strategische Fahrplan: So kompensieren Sie den Funktionsverlust

Auch gänzlich ohne die bequeme automatisierte Selfie-Analyse bietet das neue Betriebssystem weiterhin mächtige Werkzeuge, sofern man als Nutzer genau weiß, wie man sie rechtskonform und effizient einsetzt. Es gilt nun, die eigenen gewohnten Workflows klug anzupassen und auf bewährte, manuelle Methoden zurückzugreifen, die von der strengen europäischen KI-Regulierung völlig unangetastet bleiben. Aktuelle Studien zur Mensch-Maschine-Interaktion belegen, dass Nutzer, die ihre digitalen Bibliotheken proaktiv und systematisch strukturieren, einen ähnlich hohen praktischen Nutzen aus den verbleibenden Suchfunktionen ziehen können wie User vollautomatisierter KI-Systeme.

Die Top 3 Alternativen zur Apple Intelligence Gesichtsanalyse

Um die Lücke zu schließen, haben Experten drei wesentliche Schritte identifiziert, die Sie sofort umsetzen können. Erstens: Nutzen Sie die verbesserte textbasierte Suche für Gegenstände und Landschaften, da Objekte nicht unter den AI Act fallen. Zweitens: Pflegen Sie das Personen-Album manuell, indem Sie Namen konsequent zuweisen. Drittens: Arbeiten Sie verstärkt mit intelligenten Alben auf Basis von Zeit- und Geodaten. Wie Sie diesen Plan langfristig etablieren, zeigt die folgende Übersicht.

| Fortschritts-Phase | Was Sie jetzt tun sollten (Quality Guide) | Was Sie strikt vermeiden sollten (Rote Flaggen) |

|---|---|---|

| Phase 1: Vorbereitung (Heute) | Manuelles Tagging von Gesichtern forcieren und gezielte Zuweisung von essenziellen Favoriten-Alben nutzen. | Installation von dubiosen Drittanbieter-Apps, die eine Wiederherstellung der KI-Selfie-Analyse versprechen (extrem hohes Phishing-Risiko). |

| Phase 2: Update-Rollout | Die textbasierte, semantische Suche (Natural Language Search) in der Fotos-App intensivieren (z.B. tippen Sie: Maria lacht am Strand). | Die Region und Sprache des iPhones auf USA umstellen (dies führt zu massiven App-Store-Konflikten und verfälscht wichtige iCloud-Daten). |

| Phase 3: Langfristige Nutzung | Sich primär auf lokal verarbeitete Metadaten wie GPS-Ort, genaue Zeit und manuell hinzugefügte Keywords verlassen. | Private Bilder in ungeprüfte, außereuropäische Cloud-Dienste laden, nur um dort automatisierte, aber unsichere Tags zu erhalten. |

Die Zukunft der künstlichen Intelligenz in Europa bleibt somit auf absehbare Zeit ein ständiger, juristisch faszinierender Drahtseilakt zwischen grenzenloser technologischer Innovation und dem Schutz unserer fundamentalen Privatsphäre.

Fazit: Der ungeschönte Preis der europäischen digitalen Souveränität

Dass der kalifornische Konzern die weitreichende Selfie-Analyse für den riesigen europäischen Markt komplett aus Apple Intelligence streicht, ist ein historischer Präzedenzfall in der Tech-Industrie. Es zeigt eindrucksvoll und unwiderruflich, dass selbst die mächtigsten Technologiekonzerne der Welt ihre globalen Kernprodukte fundamental anpassen müssen, wenn Brüssel unmissverständliche rote Linien beim biometrischen Datenschutz zieht. Für den zahlenden Endverbraucher im DACH-Raum bedeutet dies zweifellos eine schwer zu schluckende Pille: Wir zahlen höchste Premium-Preise für die modernste Hardware, erhalten jedoch ein softwareseitig spürbar beschnittenes Erlebnis. Dennoch raten renommierte IT-Sicherheits-Experten zur Besonnenheit und betonen den immensen gesellschaftlichen Wert dieser Entscheidung. Die rigorose, gesetzlich erzwungene Abschaltung dieser extrem tiefen biometrischen Analysen schützt uns effektiv vor einer unsichtbaren, algorithmischen Überwachung unserer intimsten physischen Regungen. In einer modernen Welt, in der persönliche Daten längst das neue Öl sind, hat die Europäische Union ein klares Zeichen gesetzt und entschieden, dass unsere menschlichen Emotionen schlichtweg nicht zum Ausverkauf stehen – auch wenn wir als bitteren Kompromiss unsere Urlaubsfotos dafür künftig wieder mühsam selbst sortieren müssen.